Canllaw i Ddechreuwyr ar Gasglu Data AI

Dewis y Cwmni Casglu Data AI ar gyfer Eich Prosiect AI / ML

Cyflwyniad

Ar hyn o bryd, rydym yn troedio ar y llwybr cywir gyda datblygiadau sylweddol yn digwydd ar draws diwydiannau gyda chymorth AI. Os ydych chi'n cymryd gofal iechyd er enghraifft, mae systemau AI ynghyd â modelau dysgu peiriannau yn helpu arbenigwyr i ddeall canser yn well a llunio triniaethau ar ei gyfer. Mae anhwylderau niwrolegol a phryderon fel PTSD yn cael eu trin gyda chymorth AI. Mae brechlynnau'n cael eu datblygu ar gyflymder cyflym diolch i dreialon clinigol ac efelychiadau wedi'u pweru gan AI.

Nid gofal iechyd yn unig, mae pob diwydiant neu segment y mae AI yn ei gyffwrdd yn cael ei chwyldroi. Mae cerbydau ymreolaethol, siopau cyfleustra craff, gwisgoedd gwisgadwy fel FitBit a hyd yn oed ein camerâu ffôn clyfar yn gallu dal delweddau gwell o'n hwynebau gydag AI.

Diolch i'r datblygiadau arloesol sy'n digwydd yn y gofod AI, mae cwmnïau'n cyfarth i'r sbectrwm gydag amrywiol achosion ac atebion defnydd. Oherwydd hyn, rhagwelir y bydd y farchnad AI fyd-eang yn cyrraedd gwerth marchnad o tua $ 267bn erbyn diwedd 2027. Heblaw, mae tua 37% o'r busnesau sydd eisoes yn gweithredu datrysiadau AI yn eu prosesau a'u cynhyrchion.

Yn fwy diddorol, mae bron i 77% o'r cynhyrchion a'r gwasanaethau rydyn ni'n eu defnyddio heddiw yn cael eu pweru gan AI. Gyda'r cysyniad technoleg yn codi'n sylweddol ar draws fertigau, sut mae busnesau'n llwyddo i wneud yn amhosibl gydag AI?

Sut mae chatbots yn gwneud inni gredu ein bod yn siarad â bod dynol arall ar yr ochr arall?

Os ydych chi'n arsylwi ar yr ateb i bob cwestiwn, mae'n berwi i lawr i un elfen yn unig - DATA. Mae data yng nghanol yr holl weithrediadau a phrosesau AI-benodol. Mae'n ddata sy'n helpu peiriannau i ddeall cysyniadau, prosesu mewnbynnau a sicrhau canlyniadau cywir.

Mae'r holl brif atebion AI sydd allan yna yn holl gynhyrchion proses hanfodol rydyn ni'n eu galw'n gasglu data neu'n gaffael data neu'n ddata hyfforddi AI.

Pwrpas y canllaw helaeth hwn yw eich helpu chi i ddeall beth ydyw a pham ei fod yn bwysig.

Beth yw Casglu Data AI?

Nid oes gan beiriannau feddwl eu hunain. Mae absenoldeb y cysyniad haniaethol hwn yn eu gwneud yn amddifad o farn, ffeithiau a galluoedd fel rhesymu, gwybyddiaeth a mwy. Dim ond blychau neu ddyfeisiau na ellir eu symud sy'n meddiannu gofod ydyn nhw. Er mwyn eu troi'n gyfryngau pwerus, mae angen algorithmau arnoch ac yn bwysicach fyth data.

Mae pob un cynnyrch neu ddatrysiad wedi'i alluogi gan AI rydyn ni'n ei ddefnyddio heddiw ac mae'r canlyniadau maen nhw'n eu cynnig yn deillio o flynyddoedd o hyfforddiant, datblygu ac optimeiddio. O ddyfeisiau sy'n cynnig llwybrau llywio i'r systemau cymhleth hynny sy'n rhagweld methiant offer ddyddiau ymlaen llaw, mae pob endid unigol wedi mynd trwy flynyddoedd o hyfforddiant AI i allu sicrhau canlyniadau yn gywir.

Casglu data AI yw'r cam rhagarweiniol yn y broses o ddatblygu AI sy'n pennu o'r dechrau pa mor effeithiol ac effeithlon fyddai system AI. Y broses o gyrchu setiau data perthnasol o lu o ffynonellau a fydd yn helpu modelau AI i brosesu manylion yn well a chorddi canlyniadau ystyrlon.

Mathau o Ddata Hyfforddiant AI mewn Dysgu Peiriannau

Nawr, mae casglu data AI yn derm ymbarél. Gallai data yn y gofod hwn olygu unrhyw beth. Gallai fod yn destun, lluniau fideo, delweddau, sain neu gymysgedd o'r rhain i gyd. Yn fyr, data yw unrhyw beth sy'n ddefnyddiol i beiriant gyflawni ei dasg o ddysgu a sicrhau'r canlyniadau gorau posibl. I roi mwy o fewnwelediadau i chi ar y gwahanol fathau o ddata, dyma restr gyflym:

Gallai setiau data fod o ffynhonnell strwythuredig neu heb strwythur. Ar gyfer y setiau data strwythuredig anfwriadol yw'r rhai sydd ag ystyr a fformat penodol. Mae'n hawdd eu deall gan beiriannau. Ar y llaw arall, mae anstrwythuredig yn fanylion mewn setiau data sydd ar hyd a lled y lle. Nid ydynt yn dilyn strwythur neu fformat penodol ac mae angen ymyrraeth ddynol arnynt i dynnu mewnwelediadau gwerthfawr o setiau data o'r fath.

Data Testun

Un o'r mathau mwyaf niferus ac amlwg o ddata. Gellid strwythuro data testun ar ffurf mewnwelediadau o gronfeydd data, unedau llywio GPS, taenlenni, dyfeisiau meddygol, ffurflenni a mwy. Gallai testun anstrwythuredig fod yn arolygon, dogfennau mewn llawysgrifen, delweddau o destun, ymatebion e-bost, sylwadau cyfryngau cymdeithasol a mwy.

Data Sain

Mae setiau data sain yn helpu cwmnïau i ddatblygu gwell chatbots a systemau, dylunio rhith-gynorthwywyr a mwy. Maent hefyd yn helpu peiriannau i ddeall acenion ac ynganiadau i'r gwahanol ffyrdd y gellid gofyn un cwestiwn neu ymholiad.

Data Delwedd

Mae delweddau yn fath set ddata amlwg arall a ddefnyddir at ddibenion amrywiol. O geir hunan-yrru a chymwysiadau fel Google Lens i gydnabyddiaeth wyneb, mae delweddau'n helpu systemau i ddod o hyd i atebion di-dor.

Data Fideo

Mae fideos yn setiau data manylach sy'n gadael i beiriannau ddeall rhywbeth yn fanwl. Daw setiau data fideo o weledigaeth gyfrifiadurol, delweddu digidol a mwy.

Sut i gasglu data ar gyfer peiriant dysgu?

Felly, sut ydych chi'n dod o hyd i'ch data? Pa ddata sydd ei angen arnoch a faint ohono? Beth yw'r ffynonellau lluosog i nôl data perthnasol?

Mae cwmnïau'n asesu cilfach a phwrpas eu modelau ML ac yn nodi ffyrdd posib o ddod o hyd i setiau data perthnasol. Mae diffinio'r math o ddata sydd ei angen yn datrys cyfran fawr o'ch pryder ynghylch cyrchu data. I roi gwell syniad i chi, mae yna wahanol sianeli, llwybrau, ffynonellau neu gyfryngau ar gyfer casglu data:

Ffynonellau Am Ddim

Fel y mae'r enw'n awgrymu, mae'r rhain yn adnoddau sy'n cynnig setiau data at ddibenion hyfforddi AI am ddim. Gallai ffynonellau am ddim fod yn unrhyw beth sy'n amrywio o fforymau cyhoeddus, peiriannau chwilio, cronfeydd data a chyfeiriaduron i byrth y llywodraeth sy'n cynnal archifau gwybodaeth dros y blynyddoedd.

Os nad ydych chi am roi gormod o ymdrech i ddod o hyd i setiau data am ddim, mae gwefannau a phyrth pwrpasol fel un Kaggle, adnodd AWS, cronfa ddata UCI a mwy a fydd yn caniatáu ichi archwilio amrywiol

categorïau a dadlwythwch setiau data gofynnol am ddim.

Adnoddau Mewnol

Er ei bod yn ymddangos bod adnoddau am ddim yn opsiynau cyfleus, mae sawl cyfyngiad yn gysylltiedig â nhw. Yn gyntaf, ni allwch bob amser fod yn siŵr y byddech chi'n dod o hyd i setiau data sy'n cyfateb yn union i'ch gofynion. Hyd yn oed os ydyn nhw'n cyfateb, gallai setiau data fod yn amherthnasol o ran llinellau amser.

Os yw'ch segment marchnad yn gymharol newydd neu heb ei archwilio, ni fyddai llawer o gategorïau nac yn berthnasol

setiau data i chi eu lawrlwytho hefyd. Er mwyn osgoi'r diffygion rhagarweiniol gydag adnoddau am ddim, yno

yn bodoli adnodd data arall sy'n gweithredu fel sianel i chi gynhyrchu setiau data mwy perthnasol a chyd-destunol.

Dyma'ch ffynonellau mewnol fel cronfeydd data CRM, ffurflenni, arweinwyr marchnata e-bost, pwyntiau cyffwrdd wedi'u diffinio gan gynnyrch neu wasanaeth, data defnyddwyr, data o ddyfeisiau gwisgadwy, data gwefan, mapiau gwres, mewnwelediadau cyfryngau cymdeithasol a mwy. Mae'r adnoddau mewnol hyn yn cael eu diffinio, eu sefydlu a'u cynnal gennych chi. Felly, fe allech chi fod yn sicr o'i hygrededd, ei berthnasedd a'i dderbynfa.

Adnoddau taledig

Waeth pa mor ddefnyddiol y maent yn swnio, mae gan adnoddau mewnol eu cyfran deg o gymhlethdodau a chyfyngiadau hefyd. Er enghraifft, bydd y rhan fwyaf o ffocws eich cronfa dalent yn mynd i optimeiddio pwyntiau cyffwrdd data. Ar ben hynny, rhaid i'r cydgysylltu ymhlith eich timau a'ch adnoddau fod yn amhosib hefyd.

Er mwyn osgoi mwy o hiccups o'r fath fel y rhain, rydych chi wedi talu ffynonellau. Maent yn wasanaethau sy'n cynnig y setiau data mwyaf defnyddiol a chyd-destunol i chi ar gyfer eich prosiectau ac yn sicrhau eich bod yn eu cael yn gyson pryd bynnag y mae ei angen arnoch.

Yr argraff gyntaf sydd gan y mwyafrif ohonom ar ffynonellau taledig neu werthwyr data yw eu bod yn ddrud. Fodd bynnag,

pan fyddwch chi'n gwneud y mathemateg, dim ond yn y tymor hir maen nhw'n rhad. Diolch i'w rhwydweithiau eang a'u methodolegau cyrchu data, byddwch yn gallu derbyn setiau data cymhleth ar gyfer eich prosiectau AI waeth pa mor annhebygol ydyn nhw.

I roi amlinelliad manwl i chi o'r gwahaniaethau ymhlith y tair ffynhonnell, dyma dabl cywrain:

| Adnoddau am Ddim | Adnoddau Mewnol | Adnoddau taledig |

|---|---|---|

| Mae setiau data ar gael am ddim. | Gallai adnoddau mewnol hefyd fod yn rhad ac am ddim yn dibynnu ar eich treuliau gweithredol. | Rydych chi'n talu gwerthwr data i ddod o hyd i setiau data perthnasol i chi. |

| Adnoddau lluosog am ddim ar gael ar-lein i lawrlwytho setiau data a ffefrir. | Rydych chi'n cael data wedi'i ddiffinio'n benodol yn unol â'ch anghenion am hyfforddiant AI. | Rydych chi'n cael data wedi'i ddiffinio'n benodol yn gyson cyhyd ag y mae ei angen arnoch chi. |

| Mae angen i chi weithio â llaw ar lunio, curadu, fformatio ac anodi setiau data. | Gallwch hyd yn oed addasu eich pwyntiau cyffwrdd data i gynhyrchu setiau data gyda'r wybodaeth ofynnol. | Mae setiau data gan werthwyr yn barod ar gyfer dysgu â pheiriannau. Yn golygu, maent wedi'u hanodi ac yn dod gyda sicrwydd ansawdd. |

| Cadwch yn ofalus ynghylch cyfyngiadau trwyddedu a chydymffurfio ar setiau data rydych chi'n eu lawrlwytho. | Mae adnoddau mewnol yn dod yn risg os oes gennych amser cyfyngedig i farchnata am eich cynnyrch. | Gallwch ddiffinio'ch dyddiadau cau a darparu setiau data yn unol â hynny. |

Sut mae data gwael yn effeithio ar eich uchelgeisiau AI?

Gwnaethom restru'r tri adnodd data mwyaf cyffredin am y rheswm y bydd gennych syniad ar sut i fynd ati i gasglu a chyrchu data. Fodd bynnag, ar y pwynt hwn, mae'n hanfodol deall hefyd y gallai eich penderfyniad yn ddieithriad benderfynu tynged eich datrysiad AI.

Yn debyg i sut y gall data hyfforddi AI o ansawdd uchel helpu'ch model i sicrhau canlyniadau cywir ac amserol, gall data hyfforddi gwael hefyd dorri'ch modelau AI, gogwyddo canlyniadau, cyflwyno rhagfarn a chynnig canlyniadau annymunol eraill.

Ond pam mae hyn yn digwydd? Onid oes unrhyw ddata i fod i hyfforddi a gwneud y gorau o'ch model AI? Yn onest, na. Gadewch i ni ddeall hyn ymhellach.

Data Gwael - Beth ydyw?

Y gwahaniaeth rhwng data anstrwythuredig a data gwael yw bod mewnwelediadau mewn data anstrwythuredig ledled y lle. Ond yn y bôn, gallen nhw fod yn ddefnyddiol beth bynnag. Trwy dreulio amser ychwanegol, byddai gwyddonwyr data yn dal i allu tynnu gwybodaeth berthnasol o setiau data anstrwythuredig. Fodd bynnag, nid yw hynny'n wir gyda data gwael. Nid yw'r setiau data hyn yn cynnwys unrhyw fewnwelediadau na gwybodaeth gyfyngedig sy'n werthfawr neu'n berthnasol i'ch prosiect AI neu ei ddibenion hyfforddi.

Felly, pan fyddwch chi'n dod o hyd i'ch setiau data o adnoddau am ddim neu wedi sefydlu pwyntiau cyffwrdd data mewnol llac, mae'n debygol iawn y byddwch chi'n lawrlwytho neu'n cynhyrchu data gwael. Pan fydd eich gwyddonwyr yn gweithio ar ddata gwael, rydych chi nid yn unig yn gwastraffu oriau dynol ond yn gwthio lansiad eich cynnyrch hefyd.

Os ydych chi'n dal yn aneglur beth all data gwael ei wneud i'ch uchelgeisiau, dyma restr gyflym:

- Rydych chi'n treulio oriau di-ri yn cyrchu'r data gwael ac yn gwastraffu oriau, ymdrech ac arian ar adnoddau.

- Gallai data gwael nôl trafferthion cyfreithiol i chi, os nad oes neb yn sylwi arno a gallant leihau effeithlonrwydd eich AI

modelau. - Pan fyddwch chi'n cymryd eich cynnyrch sydd wedi'i hyfforddi ar ddata gwael yn fyw, mae'n effeithio ar brofiad y defnyddiwr

- Gallai data gwael beri i ganlyniadau a chasgliadau fod yn rhagfarnllyd, a allai ddod ag adlachiadau ymhellach.

Felly, os ydych chi'n pendroni a oes ateb i hyn, mae yna mewn gwirionedd.

Hyfforddwyr AI Darparwyr data i'r adwy

Y cyfan sy'n rhaid i chi ei wneud yw cynnwys y data a hyfforddi'ch modelau AI i berffeithrwydd. Wedi dweud hynny, rydym yn siŵr bod eich cwestiwn nesaf ar y treuliau sy'n gysylltiedig â chydweithio â gwerthwyr data. Rydym yn deall bod rhai ohonoch eisoes yn gweithio ar gyllideb feddyliol a dyna'n union lle rydyn ni'n mynd yn rhy nesaf.

Ffactorau i'w hystyried wrth lunio Cyllideb effeithiol ar gyfer eich Prosiect Casglu Data

Mae hyfforddiant AI yn ddull systematig a dyna pam mae cyllidebu yn dod yn rhan annatod ohono. Dylid ystyried ffactorau fel RoI, cywirdeb canlyniadau, methodolegau hyfforddi a mwy cyn buddsoddi swm enfawr o arian i ddatblygiad AI. Mae llawer o reolwyr prosiect neu berchnogion busnes yn ymbalfalu ar hyn o bryd. Maent yn gwneud penderfyniadau brysiog sy'n dod â newidiadau anadferadwy yn eu proses datblygu cynnyrch, gan eu gorfodi yn y pen draw i wario mwy.

Fodd bynnag, bydd yr adran hon yn rhoi'r mewnwelediadau cywir i chi. Pan fyddwch chi'n eistedd i lawr i weithio ar y gyllideb ar gyfer hyfforddiant AI, mae tri pheth neu ffactor yn anochel.

Gadewch i ni edrych ar bob un yn fanwl.

Cyfaint y data sydd ei angen arnoch chi

Rydyn ni wedi bod yn dweud yn gyffredinol bod effeithlonrwydd a chywirdeb eich model AI yn dibynnu ar faint y caiff ei hyfforddi. Mae hyn yn golygu po fwyaf y nifer o setiau data, y mwyaf yw'r dysgu. Ond mae hyn yn amwys iawn. I roi nifer i'r syniad hwn, cyhoeddodd Dimensional Research adroddiad a ddatgelodd fod angen o leiaf 100,000 o setiau data sampl ar fusnesau i hyfforddi eu modelau AI.

Erbyn 100,000 o setiau data, rydym yn golygu 100,000 o setiau data perthnasol o ansawdd. Dylai'r setiau data hyn fod â'r holl briodoleddau, anodiadau a mewnwelediadau hanfodol sy'n ofynnol i'ch algorithmau a'ch modelau dysgu peiriant brosesu gwybodaeth a chyflawni tasgau a fwriadwyd.

Gyda hyn yn rheol gyffredinol, gadewch i ni ddeall ymhellach bod maint y data sydd ei angen arnoch hefyd yn dibynnu ar ffactor cymhleth arall sy'n achos defnydd eich busnes. Mae'r hyn rydych chi'n bwriadu ei wneud gyda'ch cynnyrch neu ddatrysiad hefyd yn penderfynu faint o ddata sydd ei angen arnoch chi. Er enghraifft, byddai gan fusnes sy'n adeiladu peiriant argymell wahanol ofynion cyfaint data na chwmni sy'n adeiladu chatbot.

Strategaeth Prisio Data

Pan fyddwch chi'n gorffen cwblhau faint o ddata sydd ei angen arnoch chi mewn gwirionedd, mae angen i chi weithio nesaf ar strategaeth brisio data. Mae hyn, yn syml, yn golygu sut y byddech chi'n talu am y setiau data rydych chi'n eu caffael neu'n eu cynhyrchu.

Yn gyffredinol, dyma'r strategaethau prisio confensiynol a ddilynir yn y farchnad:

| Math o Ddata | Strategaeth Prisio |

|---|---|

| Pris fesul ffeil delwedd sengl | |

| Pris yr eiliad, munud, awr, neu ffrâm unigol | |

| Pris yr eiliad, munud, neu awr | |

| Pris fesul gair neu frawddeg |

Ond aros. Rheol bawd yw hon eto. Mae gwir gost caffael setiau data hefyd yn dibynnu ar ffactorau fel:

- Y segment marchnad unigryw, demograffeg neu ddaearyddiaeth lle mae'n rhaid dod o hyd i setiau data

- Cymhlethdod eich achos defnydd

- Faint o ddata sydd ei angen arnoch chi?

- Eich amser i farchnata

- Unrhyw ofynion wedi'u teilwra a mwy

Os byddwch chi'n arsylwi, byddwch chi'n gwybod y gallai'r gost i gaffael swmp-ddelweddau o ddelweddau ar gyfer eich prosiect AI fod yn llai ond os oes gennych chi ormod o fanylebau, gallai'r prisiau saethu i fyny.

Eich Strategaethau Cyrchu

Mae hyn yn anodd. Fel y gwelsoch, mae yna wahanol ffyrdd o gynhyrchu neu ddod o hyd i ddata ar gyfer eich modelau AI. Byddai synnwyr cyffredin yn mynnu mai adnoddau am ddim yw'r gorau gan y gallwch chi lawrlwytho'r cyfeintiau angenrheidiol o setiau data am ddim heb unrhyw gymhlethdodau.

Ar hyn o bryd, byddai hefyd yn ymddangos bod ffynonellau taledig yn rhy ddrud. Ond dyma lle mae haen o gymhlethdod yn cael ei hychwanegu. Pan fyddwch chi'n cyrchu setiau data o adnoddau am ddim, rydych chi'n treulio mwy o amser ac ymdrech yn glanhau'ch setiau data, yn eu llunio i'ch fformat busnes-benodol ac yna'n eu hanodi'n unigol. Rydych chi'n ysgwyddo costau gweithredol yn y broses.

Gyda ffynonellau taledig, mae'r taliad yn un-amser ac rydych hefyd yn cael setiau data parod ar gyfer peiriannau ar yr adeg y mae ei hangen arnoch. Mae'r gost-effeithiolrwydd yn oddrychol iawn yma. Os ydych chi'n teimlo y gallech chi fforddio treulio amser yn anodi setiau data am ddim, fe allech chi gyllidebu yn unol â hynny. Ac os ydych chi'n credu bod eich cystadleuaeth yn ffyrnig a chydag amser cyfyngedig i farchnata, gallwch greu effaith cryfach yn y farchnad, dylai fod yn well gennych ffynonellau taledig.

Mae cyllidebu yn ymwneud â chwalu'r manylion penodol a diffinio pob darn yn glir. Dylai'r tri ffactor hyn eich gwasanaethu fel map ffordd ar gyfer eich proses gyllidebu hyfforddiant AI yn y dyfodol.

Ydych chi'n cynilo ar dreuliau gyda Chaffael Data yn fewnol?

Rydym yn gwybod eich bod yn dal yn betrusgar ynghylch ffynonellau taledig a dyna pam y bydd yr adran hon yn clirio eich amheuaeth yn ei chylch ac yn taflu goleuni ar y costau cudd sy'n gysylltiedig â chynhyrchu data yn fewnol.

A yw Caffael Data Mewnol yn Drud?

Ydy!

Nawr, dyma ymateb cywrain. Treul yw unrhyw beth rydych chi'n ei wario. Wrth drafod adnoddau am ddim, gwnaethom ddatgelu eich bod yn gwario arian, amser ac ymdrech yn y broses. Mae hyn yn berthnasol i gaffael data mewnol hefyd.

Yn y pen draw, byddech chi'n gwario gwariant ar dalu'ch gweithwyr, gwyddonwyr data, anodwyr, gweithwyr proffesiynol sicrhau ansawdd a mwy. Byddwch hefyd yn gwario ar danysgrifiadau ar gyfer offer anodi a

cynnal CMS, CRM a threuliau seilwaith eraill.

Ar ben hynny, mae setiau data yn sicr o fod â phryderon rhagfarn a chywirdeb, y mae angen i chi eu didoli â llaw. Ac os oes gennych fater athreuliad yn eich tîm data hyfforddi AI, bydd yn rhaid i chi wario ar recriwtio aelodau newydd, eu cyfeirio at eich prosesau, eu hyfforddi i ddefnyddio'ch offer a mwy.

Byddwch yn y pen draw yn gwario mwy na'r hyn y byddech chi'n ei wneud yn y pen draw. Mae yna gostau anodi hefyd. Ar unrhyw adeg benodol, cyfanswm y gost a godir i weithio gyda data mewnol yw:

Cost a Ysgogwyd = Nifer yr Anodwyr * Cost yr anodwr + Cost y platfform

Os yw'ch calendr hyfforddi AI wedi'i drefnu ar gyfer misoedd, dychmygwch y treuliau y byddech chi'n eu hysgwyddo'n gyson. Felly, ai hwn yw'r ateb delfrydol i bryderon caffael data neu a oes unrhyw ddewis arall?

Manteision darparwr gwasanaeth Casglu Data AI o'r dechrau i'r diwedd

Mae datrysiad dibynadwy i'r broblem hon ac mae ffyrdd gwell a llai costus o gaffael data hyfforddi ar gyfer eich modelau AI. Rydym yn eu galw'n hyfforddi darparwyr gwasanaeth data neu'n werthwyr data.

Maent yn fusnesau fel Shaip sy'n arbenigo mewn cyflwyno setiau data o ansawdd uchel yn seiliedig ar eich anghenion a'ch gofynion unigryw. Maen nhw'n dileu'r holl drafferthion rydych chi'n eu hwynebu wrth gasglu data fel cyrchu setiau data perthnasol, eu glanhau, eu crynhoi a'u hanodi a mwy, ac mae'n gadael i chi ganolbwyntio ar optimeiddio'ch modelau a'ch algorithmau AI yn unig. Trwy gydweithio â gwerthwyr data, rydych chi'n canolbwyntio ar bethau sy'n bwysig ac ar y rhai y mae gennych reolaeth drostynt.

Ar ben hynny, byddwch hefyd yn dileu'r holl drafferthion sy'n gysylltiedig â dod o hyd i setiau data o adnoddau mewnol a rhad ac am ddim. Er mwyn rhoi gwell dealltwriaeth i chi o fantais darparwr data o'r dechrau i'r diwedd, dyma restr gyflym:

- Mae darparwyr gwasanaeth data hyfforddi yn deall eich segment marchnad yn llwyr, yn defnyddio achosion, demograffeg a manylion penodol eraill i nôl y data mwyaf perthnasol i chi ar gyfer eich model AI.

- Mae ganddyn nhw'r gallu i ddod o hyd i setiau data amrywiol sy'n addas ar gyfer eich prosiect fel delweddau, fideos, testun, ffeiliau sain neu bob un o'r rhain.

- Mae gwerthwyr data yn glanhau data, ei strwythuro a'i dagio â phriodoleddau a mewnwelediadau y mae peiriannau ac algorithmau yn gofyn amdanynt i'w dysgu a'u prosesu. Mae hwn yn ymdrech â llaw sy'n gofyn am sylw manwl i fanylion ac amser.

- Mae gennych arbenigwyr pwnc sy'n gofalu am anodi darnau hanfodol o wybodaeth. Er enghraifft, os yw'ch achos defnyddio cynnyrch yn y gofod gofal iechyd, ni allwch ei anodi gan weithiwr proffesiynol nad yw'n ofal iechyd a disgwyliwch ganlyniadau cywir. Gyda gwerthwyr data, nid yw hynny'n wir. Maent yn gweithio gyda busnesau bach a chanolig ac yn sicrhau bod eich data delweddu digidol yn cael ei anodi'n briodol gan gyn-filwyr y diwydiant.

- Maent hefyd yn gofalu am ddad-adnabod data ac yn cadw at HIPAA neu gydymffurfiadau a phrotocolau eraill sy'n benodol i'r diwydiant fel eich bod yn cadw draw oddi wrth unrhyw gymhlethdodau cyfreithiol a phob math ohonynt.

- Mae gwerthwyr data yn gweithio'n ddiflino wrth ddileu rhagfarn o'u setiau data, gan sicrhau bod gennych ganlyniadau a chasgliadau gwrthrychol.

- Byddwch hefyd yn derbyn y setiau data mwyaf diweddar yn eich arbenigol fel bod eich modelau AI wedi'u optimeiddio er mwyn sicrhau'r effeithlonrwydd gorau posibl.

- Maent hefyd yn hawdd gweithio gyda nhw. Er enghraifft, gellir cyfleu newidiadau sydyn i'r gofynion data iddynt a byddent yn dod o hyd i ddata priodol yn ddi-dor yn seiliedig ar anghenion wedi'u diweddaru.

Gyda'r ffactorau hyn, credwn yn gryf eich bod bellach yn deall pa mor gost-effeithiol a syml yw cydweithredu â darparwyr data hyfforddi. Gyda'r ddealltwriaeth hon, gadewch i ni ddarganfod sut y gallech chi ddewis y gwerthwr data mwyaf delfrydol ar gyfer eich prosiect AI.

Cyrchu Setiau Data Perthnasol

Deall eich marchnad, defnyddio achosion, demograffeg i ddod o hyd i setiau data diweddar, boed yn ddelweddau, fideos, testun neu sain.

Data Perthnasol Glân

Strwythur a thagio'r data gyda phriodoleddau a mewnwelediadau y mae peiriannau ac algorithmau yn eu deall.

Rhagfarn Data

Dileu rhagfarn o setiau data, gan sicrhau bod gennych ganlyniadau a chasgliadau gwrthrychol.

Anodi Data

Mae arbenigwyr pwnc o barthau penodol yn gofalu am anodi darnau hanfodol o wybodaeth.

Dad-adnabod Data

Cadw at HIPAA, GDPR, neu gydymffurfiadau a phrotocolau eraill sy'n benodol i'r diwydiant i ddileu cymhlethdodau cyfreithiol.

Sut i ddewis y Cwmni Casglu Data AI cywir

Nid yw dewis cwmni casglu data AI mor gymhleth na llafurus â chasglu data o adnoddau am ddim. Dim ond ychydig o ffactorau syml sydd angen i chi eu hystyried ac yna ysgwyd llaw am gydweithrediad.

Pan fyddwch chi'n dechrau chwilio am werthwr data, rydyn ni'n cymryd eich bod chi wedi dilyn ac ystyried beth bynnag rydyn ni wedi'i drafod hyd yn hyn. Fodd bynnag, dyma ailadrodd cyflym:

- Mae gennych achos defnydd wedi'i ddiffinio'n dda mewn golwg

- Mae eich segment marchnad a'ch gofynion data wedi'u sefydlu'n glir

- Mae eich cyllidebu ar bwynt

- Ac mae gennych chi syniad o faint o ddata sydd ei angen arnoch chi

Gyda'r eitemau hyn wedi'u gwirio, gadewch i ni ddeall sut allwch chi chwilio am ddarparwr gwasanaeth data hyfforddi delfrydol.

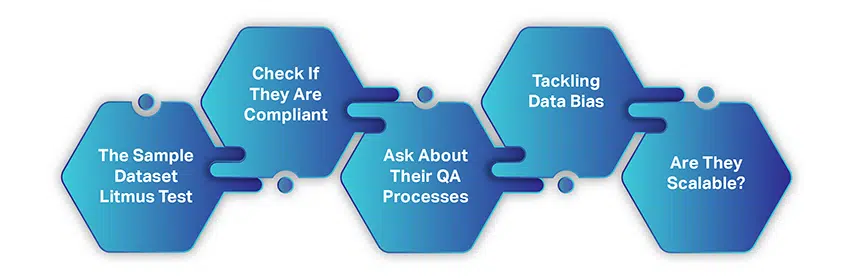

Prawf Litmus Sampl y Set Ddata

Cyn llofnodi bargen hirdymor, mae bob amser yn syniad da deall gwerthwr data yn fanwl. Felly, dechreuwch eich cydweithrediad â gofyniad o set ddata enghreifftiol y byddwch chi'n talu amdani.

Gallai hyn fod yn nifer fach o set ddata i asesu a ydyn nhw wedi deall eich gofynion, a yw'r strategaethau caffael cywir ar waith, eu gweithdrefnau cydweithredu, tryloywder a mwy. O ystyried y ffaith y byddech mewn cysylltiad â gwerthwyr lluosog ar y pwynt hwn, bydd hyn yn eich helpu i arbed amser ar benderfynu darparwr a chwblhau pwy sy'n fwy addas ar gyfer eich anghenion yn y pen draw.

Gwiriwch a ydyn nhw'n cydymffurfio

Yn ddiofyn, mae'r rhan fwyaf o ddarparwyr gwasanaeth data hyfforddi yn cydymffurfio â'r holl ofynion a phrotocolau rheoliadol. Fodd bynnag, dim ond i fod ar yr ochr ddiogel, ymholi am eu cydymffurfiadau a'u polisïau ac yna culhau'ch dewis.

Gofynnwch Am Eu Prosesau SA

Mae'r broses o gasglu data ynddo'i hun yn systematig ac yn haenog. Mae methodoleg linellol yn cael ei gweithredu. I gael syniad o sut maen nhw'n gweithredu, gofynnwch am eu prosesau SA a holi a yw'r setiau data maen nhw'n eu ffynhonnell a'u hanodi yn cael eu pasio trwy wiriadau ansawdd ac archwiliadau. Bydd hyn yn rhoi

syniad ynghylch a yw'r cyflawniadau terfynol y byddech chi'n eu derbyn yn barod ar gyfer peiriannau.

Mynd i'r Afael â Rhagfarn Data

Dim ond cwsmer gwybodus fyddai'n gofyn am ragfarn mewn setiau data hyfforddi. Pan fyddwch chi'n siarad â gwerthwyr data hyfforddi, siaradwch am ragfarn data a sut maen nhw'n llwyddo i gael gwared ar ragfarn yn y setiau data maen nhw'n eu cynhyrchu neu'n eu caffael. Er ei bod yn synnwyr cyffredin ei bod yn anodd dileu rhagfarn yn llwyr, fe allech chi wybod yr arferion gorau maen nhw'n eu dilyn i gadw rhagfarn yn y bae.

A ydyn nhw'n Scalable?

Mae cyflawniadau un-amser yn dda. Mae cyflawniadau tymor hir yn well. Fodd bynnag, y cydweithrediadau gorau yw'r rhai sy'n cefnogi gweledigaethau eich busnes ac ar yr un pryd yn graddio eu cyflawniadau â'ch cynnydd

Gofynion.

Felly, trafodwch a all y gwerthwyr rydych chi'n siarad â nhw gynyddu o ran maint y data os bydd angen yn codi. Ac os gallant, sut y bydd y strategaeth brisio yn newid yn unol â hynny.

Casgliad

Ydych chi eisiau gwybod llwybr byr i ddod o hyd i'r darparwr data hyfforddi AI gorau? Cysylltwch â ni. Sgipiwch yr holl brosesau diflas hyn a gweithio gyda ni i gael y setiau data mwyaf o ansawdd uchel a manwl gywir ar gyfer eich modelau AI.

Rydyn ni'n gwirio'r holl flychau rydyn ni wedi'u trafod hyd yn hyn. Ar ôl bod yn arloeswr yn y gofod hwn, rydym yn gwybod beth sydd ei angen i adeiladu a graddio model AI a sut mae data yng nghanol popeth.

Credwn hefyd fod Canllaw'r Prynwr yn helaeth ac yn ddyfeisgar mewn gwahanol ffyrdd. Mae hyfforddiant AI yn gymhleth fel y mae ond gyda'r awgrymiadau a'r argymhellion hyn, gallwch eu gwneud yn llai diflas. Yn y diwedd, eich cynnyrch yw'r unig elfen a fydd yn y pen draw yn elwa o hyn i gyd.

Onid ydych chi'n cytuno?